Principais conclusões

- Verdadeiros assistentes no dispositivo, como o Gemini Nano, estão revolucionando a experiência do smartphone.

- LLMs especializados são o futuro, oferecendo conhecimento personalizado para tarefas ou setores específicos.

- A integração aprimorada de casa inteligente com LLMs pode levar a comandos mais intuitivos e automação contínua.

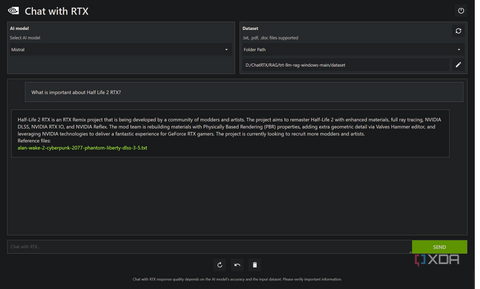

O mundo dos grandes modelos de linguagem tem evoluído lentamente, acompanhado de novas melhorias e mudanças ao longo do tempo. Vimos iterações do GPT-4 à medida que a OpenAI continua a melhorar o modelo, e avanços como a Geração Aumentada de Recuperação (RAG) começaram a potencializar soluções locais como o Chat com RTX. Porém, há muito mais que poderia estar acontecendo no mundo dos modelos de linguagem, e essas são as coisas que adoraríamos ver a seguir.

ChatGPT vs Microsoft Copilot vs Google Gemini: Quais são as diferenças?

Se você está tentando descobrir qual ferramenta de IA generativa é melhor, você veio ao lugar certo

1 Verdadeiros assistentes no dispositivo

Melhore o Siri e o Google Assistant

Assistentes no dispositivo têm sido uma coisa para anos agora, mas eles tendem a ser bastante básicos e utilizam a nuvem para fornecer seus melhores recursos. LLMs como o Gemini Nano podem ser executados no dispositivo e atualmente estão sendo testados em empresas como o Google Pixel 8 Pro e o Samsung Galaxy S24. Estes são verdadeiro assistentes no dispositivo que imaginamos pela primeira vez com smartphones anos e anos atrás e que podem tornar nossos smartphones mais poderosos do que nunca.

Esperamos que esses assistentes, no futuro, também possam controlar seu dispositivo para você, embora possam ser necessárias salvaguardas para garantir que funcionem adequadamente. Ser capaz de pedir a um assistente no dispositivo para ativar o modo escuro, conectar-se a uma rede Wi-Fi ou instalar um aplicativo para você parece ótimo, mas também pode ser abusado. Há muito trabalho necessário nesta área, mas também há muito potencial.

2 Treinamento para doutrinas específicas

LLMs construídos para fins específicos

Isso já está acontecendo, mas acho que os LLMs treinados para fins específicos são o futuro dos grandes modelos de linguagem. Por exemplo, um modelo treinado em código Python (e apenas em código Python) será uma grande ajuda para qualquer pessoa que precise de ajuda com programação em Python. A ajuda adicional de um corpus maior de dados também ajuda muito, mas, em geral, o treinamento focado de um modelo em tópicos específicos será uma vantagem na luta contra alucinações e outros problemas.

LLMs como esses também são ótimos para grandes empresas com uma grande quantidade de documentação de treinamento, e isso também remonta ao RAG. Com uma enorme quantidade de documentação e um LLM relativamente fraco, um LLM ainda pode obter as informações relevantes de um conjunto de documentos. Um sistema interno de ajuda aos funcionários é exatamente o tipo de situação em que funcionaria bem, pois a empresa poderia ter um ajudante interno que pudesse responder às perguntas dos funcionários e, ao mesmo tempo, não correr o risco de vazamento de dados.

3 Melhor integração de casa inteligente

Ok Google, acenda as luzes

Do jeito que está, existem algumas integrações de casa inteligente que Alexa e o Google Assistant já possuem, mas os comandos são muito rígidos. Não há elemento de conversação e, às vezes, eles podem ter dificuldades com as coisas, dependendo da maneira como são ditas. Também não me refiro a sotaques, quero dizer algo como uma frase de efeito. O Hiberno-English, o dialeto do inglês que falamos na Irlanda, tem vários idiomas que são traduções diretas do irlandês. Embora Alexa tenha melhorado com isso, às vezes ainda pode ter dificuldades. Um LLM treinado em um amplo corpus de dados, entretanto, normalmente entenderia o que isso significa.

Para esse fim, ser capaz de dizer algo como “Ei Google, quando eu chegar em casa, acenda as luzes e ajuste o termostato para 70 graus Fahrenheit” é algo que tenho certeza que muitas pessoas gostariam de poder dizer ao telefone. com confiança de que funcionará. Esses são os casos de uso em que acredito que os LLMs podem realmente beneficiar os usuários, mas isso precisa ser feito corretamente.

GPT-4 com seu interpretador de código é o primeiro passo

Eu adoraria que um LLM fosse devidamente capaz de fazer uso de ferramentas. Dê a ele uma calculadora, assistentes de pesquisa, um IDE, qualquer coisa que ele possa usar para melhorar o serviço. Do jeito que está, pedir ao GPT-4 para calcular algo fará com que ele escreva um programa Python para calcular a resposta, o que certamente é um passo na direção certa. Por outro lado, o Gemini Advanced e o Copilot do Google não farão isso, em vez disso adivinharão a resposta com base no que está mais próximo em suas bases de conhecimento.

Tudo isso quer dizer que fornecer ferramentas aos LLMs os tornará muito mais poderosos muito rapidamente, e acho que é exatamente nisso que a OpenAI está trabalhando atualmente. ChatGPT Plus com GPT-4 já está fazendo um ótimo trabalho neste departamento e quero ver ainda melhor.

Tentei fazer Minecraft com ChatGPT

Tentei usar o ChatGPT para fazer um clone básico do Minecraft no Unity, e os resultados foram… interessantes

O futuro dos LLMs é brilhante

Se você é um entusiasta de IA, os avanços nos LLMs devem ser empolgantes. Com o GPT-5 potencialmente no horizonte e chegando neste verão, Altman disse que o GPT-4 “é uma merda” em comparação. Isso deve deixar você animado. Com o GPT-4 demonstrando o uso da ferramenta também por meio do intérprete de código e dos assistentes no dispositivo começando a ser implementados, suspeito que os LLMs em breve se tornarão ferramentas melhores no futuro próximo do que nunca.