O Google Gemini Pro 1.5 é um momento de mudança para a inteligência artificial multimodal. Permite alimentá-lo com um arquivo de vídeo, áudio ou imagem e tirar dúvidas sobre o conteúdo.

Para ver seu desempenho, apresentei ao Gemini Pro 1.5 um vídeo completamente silencioso do momento da totalidade do recente eclipse solar total visível na América do Norte.

Trabalhando na plataforma VertexAI do Google Cloud, também pude dar algumas instruções ao Gemini junto com o videoclipe. Pedi para escrever a letra e um prompt para um gerador de música de IA criar uma música inspirada no conteúdo do vídeo.

Em seguida, coloquei o prompt e a letra no Udio para criar a música e coloquei a faixa completa de volta no Gemini Pro 1.5 e pedi para ouvir a faixa e traçar um videoclipe.

O que é o Google Gemini Pro 1.5?

O Google lançou sua família de modelos Gemini em novembro, começando com o minúsculo Nano, que está disponível em alguns telefones Android. Em seguida, abandonou o Pro, que agora alimenta o chatbot Gemini, e finalmente lançou em janeiro o poderoso Gemini Ultra de nível GPT-4.

No mês passado, o gigante das buscas lançou sua primeira atualização para a família Gemini, revelando o Gemini Pro 1.5, que possui uma enorme janela de contexto de milhões de tokens, uma mistura de arquitetura especializada para melhorar a capacidade de resposta e precisão, bem como verdadeiras capacidades multimodais.

Embora atualmente esteja disponível apenas para desenvolvedores por meio de uma chamada de API ou da plataforma em nuvem VertexAI, espera-se que essa funcionalidade avançada apareça no chatbot Gemini em breve.

Alguns dos recursos incluem a capacidade de fazer upload de um arquivo de áudio, como uma música ou um discurso, um arquivo de vídeo de alguém se exercitando ou de um eclipse solar e fazer perguntas a Gêmeos sobre o arquivo.

Criando uma música a partir de um vídeo

Embora você não possa gerar uma música diretamente usando o Gemini Pro 1.5 – o Google tem outros modelos de IA para criar música e vídeo – você pode criar prompts e letras.

Dei ao modelo de IA um pequeno clipe de 25 segundos mostrando o momento da totalidade do recente eclipse solar total visível nos EUA e pedi que ele me desse as letras e um aviso que eu pudesse alimentar em um gerador de música de IA para criar uma música inspirada pelo vídeo.

Lançamento do novo desenvolvedor do @Google hoje: – Gemini 1.5 Pro já está disponível em mais de 180 países por meio da API Gemini em visualização pública – Suporta capacidade de compreensão de áudio (fala) e uma nova API de arquivo para facilitar o manuseio de arquivos – Novo modelo de incorporação !https://t.co/wJk1e1BG1E9 de abril de 2024

Isso me deu isso como um estímulo para o Udio: “Uma peça orquestral épica com três movimentos distintos, o primeiro crescendo em suspense e antecipação à medida que o eclipse se aproxima da totalidade, o segundo desacelerando e se tornando etéreo e misterioso durante a totalidade, e o terceiro construindo novamente para um crescendo triunfante à medida que o sol emerge de trás da lua.

Essa era a letra do refrão: “O eclipse está aqui, um show celestial Um momento de escuridão, antes que a luz cresça As estrelas saem para brincar, no céu do meio-dia Uma visão única na vida, enquanto o mundo passa .”

Não acho que o Gemini Pro 1.5 seja tão criativo quanto Claude 3, ChatGPT ou Gemini Ultra. As letras dessas plataformas tendem a ser mais inventivas, mas a capacidade de analisar um vídeo é enorme. Foi capaz de avaliar os diferentes momentos do vídeo, captar as mudanças e refletir nas letras.

Criando um videoclipe a partir de uma música

Uma das atualizações mais recentes do Google Gemini 1.5 é a capacidade de pegar uma música ou qualquer trecho de áudio e analisar seu conteúdo. Achei isso particularmente útil no planejamento de ideias para um videoclipe que combine com aquela música – especialmente se estou trabalhando rápido.

Peguei a música que gerei no Udio usando o prompt e a letra do Gemini Pro 1.5 e pedi ao modelo de IA para traçar um videoclipe cena a cena com base no arquivo de áudio.

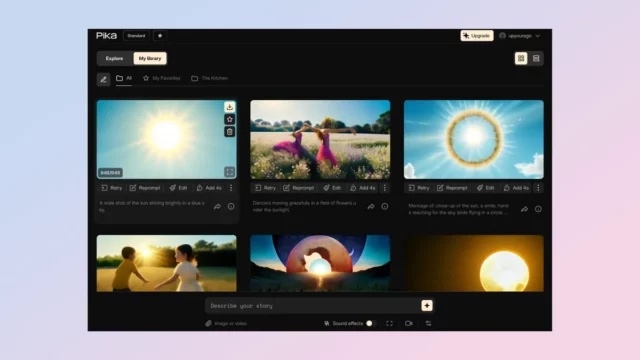

Isso me deu uma série de cenas de 5 segundos para cada parte da música, incluindo a introdução e o refrão. Para cada seção recebi uma sugestão como “gerar uma bela paisagem com o nascer do sol e os pássaros voando”. Em seguida, coloquei as instruções no Pika Labs.

Isso poderia dar a um robô a capacidade de agir de forma totalmente independente, usando nada mais do que um microfone e uma câmera.

Embora este seja um exemplo incomum de como usar o Gemini Pro 1.5, é uma indicação do que poderia ser possível ou mesmo do que poderia ser construído por um desenvolvedor terceirizado. Por exemplo, você pode usar o Gemini Pro 1.5 como uma camada intermediária entre um gerador de música de IA e uma plataforma de vídeo de IA como LTX Studio ou Runway para criar uma música e um videoclipe com um clique.

O benefício real de janelas de contexto maiores surgirá quando começarmos a ver aplicações de IA, como os óculos inteligentes da Meta ou o Rabbit R1, chegando ao mercado. Se o Google conseguir resolver o problema da latência, a IA poderá analisar a massa de dados do mundo real e fornecer feedback e informações ao vivo.

Isso poderia ser usado para ajudar uma pessoa cega a ver através de audiodescrições, criar o primeiro passo em direção a verdadeiros veículos sem motorista ou dar a um robô a capacidade de agir de forma totalmente independente usando nada mais do que um microfone e uma câmera.