A Adobe está trabalhando em alguns novos recursos de vídeo de IA impressionantes para o Premiere Pro, incluindo integração com serviços de terceiros como Sora, Runway e Pika Labs da OpenAI.

A atualização está atualmente disponível apenas internamente para teste na Adobe, sem cronograma além de “este ano” para lançamento público, mas incluirá a capacidade de usar IA para estender um clipe, bem como adicionar ou remover qualquer objeto em segundos de uma sequência.

Embora a Adobe esteja fazendo experiências com terceiros, a empresa afirma que a funcionalidade principal será fornecida por meio de um novo modelo de IA generativa do Firefly Video treinado em conteúdo licenciado.

“A Adobe está reimaginando cada etapa do fluxo de trabalho de criação e produção de vídeo para dar aos criadores novo poder e flexibilidade para concretizar sua visão”, disse Ashley Still, vice-presidente sênior de produtos criativos da Adobe.

A Adobe diz que qualquer vídeo gerado por IA ou vídeo incluindo elementos de IA será rotulado como tal no Premiere Pro e nos metadados.

Por que a Adobe está trazendo Sora para o Premiere Pro?

Desde a revelação de Sora no início deste ano, a OpenAI demonstrou o potencial do vídeo de IA não apenas para criar um clipe curto de três segundos, mas também um vídeo multi-shot totalmente produzido a partir de um prompt de texto. Runway e outros estão se atualizando rapidamente.

Modelos de vídeo sintético como Sora, Runway e Pika Labs têm sido controversos entre alguns criativos, com preocupações sobre o impacto nos empregos, a proveniência dos dados de formação e a qualidade.

Ao trazer inovações generativas de IA aos principais fluxos de trabalho do Premiere Pro, estamos resolvendo problemas reais que os editores de vídeo enfrentam todos os dias, ao mesmo tempo que lhes damos mais espaço para se concentrarem em seu trabalho.

Ashley Still, vice-presidente sênior da Adobe

No entanto, esta crítica não tem sido universal, com muitos a verem a utilização da IA generativa como uma forma de melhorar a produção de vídeo existente em vez de a substituir, colocando mesmo gráficos avançados e efeitos visuais nas mãos de criadores mais pequenos de uma forma nunca antes possível.

A Adobe quer capitalizar esse potencial e o fato de inicialmente se concentrar em melhorar o fluxo de trabalho em vez de apenas gerar vídeo – como fez com o preenchimento generativo no Photoshop – é uma prova disso, e uma abordagem sensata, embora cautelosa.

Still disse: “Ao trazer inovações generativas de IA profundamente nos principais fluxos de trabalho do Premiere Pro, estamos resolvendo problemas reais que os editores de vídeo enfrentam todos os dias, ao mesmo tempo que lhes damos mais espaço para se concentrarem em seu trabalho”.

Quais recursos de IA estão chegando ao Premiere Pro?

Além dos recursos de rotulagem automática e melhoria de áudio anunciados anteriormente – como limpeza de ruído de fundo – a Adobe confirmou que está trazendo expansão generativa e edição em vídeo para o Premiere Pro.

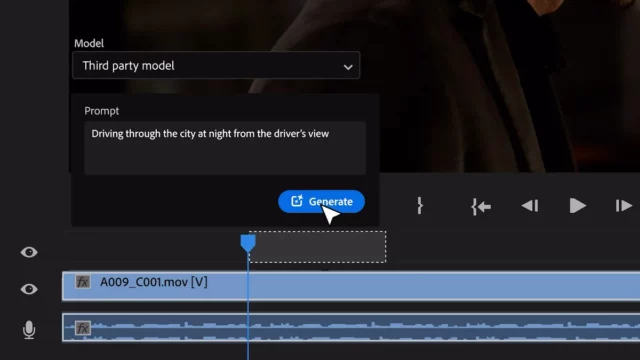

Por padrão, a expansão generativa usará o modelo de vídeo Adobe Firefly AI com lançamento previsto para este ano e pega o início do clipe que você deseja estender como material de origem e o estende por alguns quadros ou segundos.

Você o arrasta até onde quiser estendê-lo – como para corresponder a um trecho de áudio – e a IA fará o resto, gerando pixels para corresponder ao que veio antes.

Isso é semelhante ao preenchimento generativo no Photoshop, onde você pode expandir uma tela e fazer com que o Firefly preveja o que deve estar naquele espaço, gerando uma imagem correspondente.

Para que servem os novos recursos de vídeo de IA?

O outro recurso generativo de vídeo de IA trata de consertar o que já existe. Durante uma breve demonstração, vi uma caixa sendo removida de uma cena e passando consistentemente por todos os quadros do clipe – usando apenas um clique do mouse.

Outra demonstração mostrou um objeto sendo adicionado a uma cena a partir de nada além de um prompt de texto. Essas ferramentas podem ser inestimáveis para editores que desejam desfocar um rosto ou remover um objeto que quebra a consistência de várias fotos – por exemplo, uma panela ou um carro fora do lugar.

Os modelos de IA também serão capazes de gerar b-roll no Premiere Pro, de acordo com a Adobe. Usar os editores de vídeo Sora, Runway ou Pika Labs pode ser capaz de criar filmagens extras para um projeto sem ter que sair e filmá-lo.

Num vídeo partilhado pela Adobe para mostrar o potencial destas novas capacidades utilizou Runway e Sora para criar B-roll, o seu próprio modelo para remover um objeto e Pika Labs para estender um clip.

Embora nada disso esteja disponível ao público, todos os exemplos foram produzidos usando uma versão interna do Premiere Pro com integração real dos modelos de IA.